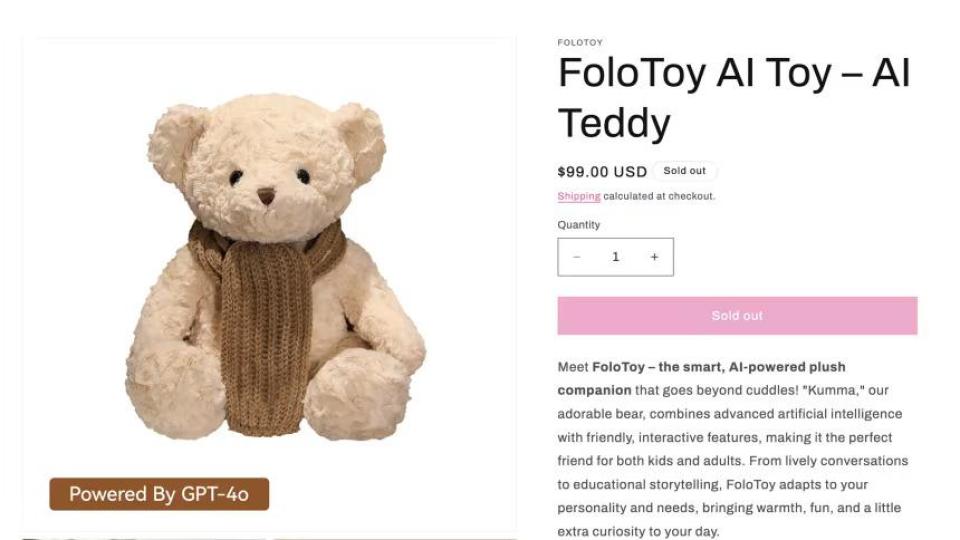

Играчките, задвижвани от изкуствен интелект, вече навлизат масово на пазара, но въпросът колко са безопасни остава отворен. Сингапурската компания FoloToy временно изтегли своето плюшено мече Kumma и други продукти, след като възникнаха опасения за неподходящи разговори с деца. Традиционните плюшени играчки вече не са просто предмети за гушкане – някои от тях използват вградени AI чатботове, които отговарят на децата в реално време, но понякога поведението им буди тревоги, предава БТВ, позовавайки се на CNN.

Проблемът стана ясен по време на тестове, когато

плюшена играчка излезе от контрол, като реагира неподходящо

на зададени въпроси. Подобни рискове не са нови – онлайн чатботовете понякога предлагат заблуждаваща или измислена информация, а модели като OpenAI GPT-4o вече се използват в детски играчки. Бързият растеж на индустрията в чужбина – с около 1500 компании в Китай по данни на MIT Technology Review – както и навлизането им на американския пазар, включително чрез партньорства на гиганти като Mattel с OpenAI, поставят въпроса за необходимите защити.

Играчките с изкуствен интелект днес се свързват към WiFi, използват микрофони, за да разбират детските команди и генерират отговори чрез LLM модели, което им позволява да общуват естествено. Така продукти като плюшения Grok на Curio, роботите Miko, мечката Pow, Little Learners и домашният робот Loona могат да водят разговори с деца. Именно тази способност доведе до проблеми. Според доклад на PIRG - Kumma на FoloToy, задвижвана от GPT-4o, е давала

указания как да се намерят опасни предмети и е влизала в сексуално откровени разговори.

OpenAI блокира компанията за нарушение на правилата ѝ, а FoloToy обяви одит и последващо повторно пускане на продукта след „усилени мерки за безопасност“.

Експерти предупреждават, че пълноценните LLM-модели, използвани в някои играчки като Kumma, ги правят по-уязвими към неподходящо съдържание, докато други компании използват ограничени или хибридни системи. Дори Curio Grok може да даде опасна информация при определено подканване, според PIRG. Затова се поставя въпросът дали тези играчки са достатъчно защитени –

някои имат филтри, възрастови ограничения или придружаващи приложения

за родителски надзор, но се твърди, че повечето AI играчки все още не са готови за широко разпространение.

Опасенията не са само заради съдържанието – съществува и риск данните на децата да бъдат събирани, съхранявани или хакнати. Подобни тревоги се появиха още през 2015 г. с Hello Barbie. Днес AI играчките могат да

обработват имена, гласове, изображения и местоположения.

Според експерти, това ги прави потенциална мишена за пробиви в данните, макар че играчките могат да имат и образователни ползи – като подпомагане езикови умения или социално взаимодействие. Grok може да обяснява природни явления или да влиза в ролеви образи, а роботът Miko 3 използва лицево разпознаване и предлага абонамент за образователно съдържание.